El filósofo alemán estuvo en la UNSAM y en una entrevista con TSS cuestionó la idea de inteligencia artificial, a la que considera una especulación y una herramienta de dominación capaz de alterar nuestra forma de pensar. Sus críticas a la ideología del Silicon Valley y su rol como usina de creación de mitologías para vender tecnología.

Agencia TSS – Al filósofo alemán Markus Gabriel le gusta ser provocativo cuando habla en público, como cuando frente al auditorio que lo escuchaba en el Centro Cultural de la Ciencia (C3), a fines de junio pasado, se refirió a Estados Unidos –y, específicamente, al Silicon Valley– como “quienes quieren dominar el mundo explotando los datos de los demás”, y a su colega Daniel Dennett como “el ministro de la propaganda californiana”.

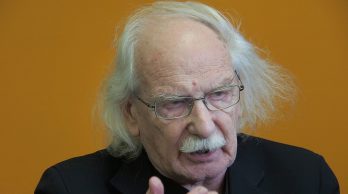

Nacido en 1980 y catedrático de la Universidad de Bonn con apenas 28 años, Gabriel se especializó en Metafísica, Epistemología y Filosofía post-kantiana. Ha recibido numerosos premios en universidades de diversos países, donde también ha sido profesor invitado. La publicación de Por qué el mundo no existe lo posicionó junto al filósofo italiano Maurizio Ferraris como creador de la corriente denominada “nuevo realismo” y un extracto de su último, El sentido del pensamiento, puede leerse en Revista Anfibia.

En un excelente español (uno de los nueve idiomas que maneja), Gabriel brindó una serie de conferencias en la Argentina (la primera en el C3 y, un día después, en la UNSAM, entre otras) en las que ofreció una perspectiva crítica sobre los sistemas que hoy son descriptos como inteligencia artificial, en la que sostuvo que “no presentan, en realidad, una forma de inteligencia ni la capacidad de pensar, ya que carecen de contexto y por lo tanto de sentido. Son más bien modelos de pensamiento, imágenes de la manera en que pensamos. No existe una inteligencia artificial real, es pura especulación, pero su imposición discursiva es importante: permite la dominación con la tecnología y cumple un rol deshumanizador”. También se mostró crítico del “neurocentrismo” como concepción de que el ser humano, su conciencia o su yo son idénticos a su cerebro.

Dueño de un gran sentido del humor, durante su exposición en el C3 Gabriel argumentó en contra del ideal transhumanista que propone la necesidad de alinear al ser humano con el progreso tecnológico y frente a la mediación algorítmica que automatiza cada vez más la vida moderna: “No podemos trasladar nuestra autonomía fáctica a un programa de computación”, sostuvo.

Usted se ha referido a la inteligencia artificial como “un intento de instalar un modelo de pensamiento humano en un hardware no humano”. ¿Qué sucede cuando se empieza a entralazar lo biológico con lo computacional? Me refiero a la posibilidad de implantes cibernéticos en seres humanos y al desarrollo de computadoras biológicas. ¿Es un desafío para su perspectiva crítica de la inteligencia artificial?

Sí, porque eso le suma una mayor complejidad a este problema, pero de una manera todavía peor a lo que critico. Es verdad que ya podemos producir neuronas y conectarlas, y que en el futuro podrían convertirse en una variante de inteligencia artificial. Todavía no sabemos a lo que nos va a llevar pero parece técnicamente posible en un futuro no tan lejano. Sin embargo, un organismo vivo tiene millones de años de evolución en la Tierra, algo que no tendrán estas hipotéticas estructuras híbridas. El contexto de evolución trasciende el conjunto dado, producido, de células. Hacen falta más elementos para una inteligencia real y estos artefactos construidos por nosotros, en los que los procesos vitales son manipulados desde afuera, no serían algo que podamos asimilar a lo que consideramos un organismo viviente. Sí lo podría ser una computadora hecha por nosotros, por ejemplo, con células madre, más un contexto artificial y procesos de automodelación. Esto sí podría ser considerado un ser inteligente, aunque muy ajeno.

¿Podríamos llegar a considerarlo humano?

No, sería un nuevo animal, producido por nosotros y con intereses ajenos a los humanos. Es decir, sería un monstruo, un Frankenstein real. Deberíamos preguntarnos si algo así es deseable.

Ahí entran en juego la ética de la investigación científica, el principio de precaución. Usted advierte sobre que las corrientes de pensamiento que hegemonizan el discurso acerca de la inteligencia artificial plantean un desafío para la ética. ¿Por qué?

La ética es la disciplina que responde al problema de quiénes somos y qué queremos ser. Entonces, ¿queremos ser realmente los productores de monstruos? Si la respuesta es no: ¿Por qué razón producir un Frankenstein? ¿Por qué crear un enemigo posible y probable para la humanidad? Si yo fuera tal monstruo destruiría a los humanos por la simple razón de que me crearon. ¡Yo no querría ser tal monstruo! No es suficiente que seamos capaces de hacer algo porque también podemos producir un Auschwitz. Entonces, la capacidad de hacer algo no es suficiente para que sea deseable, ahí es donde juega la ética, que es fundamental para reflexionar y discutir sobre ese tipo de cosas. Si no sabemos quiénes somos contribuimos a la destrucción de lo que nos hace humanos y el actual discurso sobre la inteligencia artificial no plantea los riesgos de la vida digital.

Durante su exposición mencionó la importancia de que los gobiernos se involucren en la discusión y dijo que ha conversado con funcionarios sobre este tema. ¿Qué percibió? Hay un fuerte impulso a las inversiones en inteligencia artificial en los países más poderosos.

Alemania está muy atenta respecto de este tema y se está discutiendo mucho lo que tiene que ver con la ideología y la propaganda que acompañan los discursos sobre la inteligencia artificial, para definir de qué manera se tiene que desarrollar una estrategia digital real. Alemania está enfocada en reducir el impacto de la inteligencia artificial a la industria 4.0, lo que de por sí es una iniciativa muy fuerte en el país. En Alemania hay mucha conciencia sobre el efecto manipulador que ejerce Estados Unidos sobre el resto del mundo. Es obvio que no podemos esperar la verdad ni un comportamiento sincero por parte de las grandes compañías tecnológicas, con las que, además, Alemania tiene mucha relación. En Munich, por ejemplo, se producen piezas y máquinas para las fábricas de Elon Musk.

Musk y otros referentes del mundo tecnológico han advertido sobre los peligros que entraña el desarrollo de inteligencia artificial. ¿Le parece una acción sincera o un doble discurso?

Hay un doble discurso porque, por un lado, hablan de una amenaza y, por otro, producen las condiciones de existencia de esa amenaza. Pero no me queda del todo claro si son confusos en su forma de pensar o si tienen la intención de manipular con su discurso.

Ray Kurzweil es uno de los íconos del transhumanismo y una fuente de inspiración de la narrativa que sostiene la cultura del Silicon Valley, que inclusive ha generado instituciones con un rol evangelizador como Singularity University, financiada por Google. ¿Qué análisis hace de su fundamento filosófico?

El nivel de argumentación no es mejor que el que pueden tener un Trump o un Bolsonaro. Porque, al fin y al cabo, se trata de cuestiones filosóficas. Alguien como Kurzweil detesta la filosofía y, sin embargo, se mete en ese campo y el resultado es malo. El único de ellos que está un poco por encima de la media en cuanto a seriedad es Daniel Dennett, aunque a veces parezca un agente de propaganda. Mi crítica principal es que están tratando de vender mitologías, cierta promesa de que, mediante las tecnologías de la información, podremos entrar en una era de progreso que nos elevará por sobre lo material.

¿Quién gana con esas mitologías?

Los que venden las máquinas, el software, los sensores. Son los verdaderos ganadores y necesitan alimentar esa ilusión a través de una narrativa con una fuerte carga ideológica. Es más interesante comprar lo que tiene propiedades divinas, apelan al fetichismo por la tecnología.

¿El modelo de smart cities (ciudades inteligentes) va en esa dirección?

Sí, es producto de una ideología y un recurso de marketing para vender tecnología. Tenemos que darnos cuenta que la ciudad inteligente es una fantasía y que lo que en realidad ofrecen es ciudades con muchos sensores. Eso producirá dos cosas: grandes cantidades de datos y gente más vigilada. En el caso de los datos, generan un valor económico pero no necesariamente para los ciudadanos.

¿Considera lo mismo en el caso de los vehículos autónomos?

Detrás de eso veo que lo más urgente es la intención de reducir costos, de eliminar puestos de trabajo. La fantasía de algunas empresas es poder ofrecer una movilidad sin taxistas, por ejemplo. La excusa de la seguridad es un recurso de publicidad en muchos casos. El problema es que estamos hablando de una tecnología a la que le cuesta funcionar en contextos reales, pensemos en lo que significa manejar un auto en Nueva Delhi o en Buenos Aires. La inteligencia humana es muy buena para moverse en contextos complejos pero un sistema totalmente autónomo es muy difícil que funcione fuera de ambientes medianamente controlados. Todavía estamos lejos del mundo de los Jetsons.

Usted argumenta que la digitalización cambia nuestra forma de pensar, que hay una retroalimentación entre el uso de algoritmos y la forma en que pensamos. ¿Por qué?

Porque los algoritmos nos dan un concepto de nosotros mismos. Son un modelo de pensamiento, funcionan como un espejo de nosotros. Es lo que soy, lo que hago, pero en un sentido abstracto. Esa idea abstracta entra en mi pensamiento como un virus lógico: se convierte en una realidad que nos contiene. La filosofía debe actuar como una crítica de esos virus lógicos.

Durante su exposición hizo hincapié en que no podemos dejar nuestras decisiones libradas a los algoritmos y que la forma de la civilización es la irracionalidad humana. Hemos visto crecer una corriente de rechazo a la evidencia científica en forma de movimientos negadores como creacionistas, antivacunas y terraplanistas. ¿Qué análisis hace de esto?

Que son un producto de algunas cosas que critico. La racionalidad llevada al máximo mediante el uso de algoritmos genera un nuevo espacio completamente irracional. El espacio privado, la subjetividad, la intimidad, siempre tienen su lado irracional. El sexo, por ejemplo, es algo muy irracional, no responde solo a una lógica de la reproducción. Cada vez hay menos espacio privado por la introducción masiva de la inteligencia artificial en la vida cotidiana. Este proceso genera una nueva subjetividad en la que el sujeto le da impulso a la emergencia de movimientos irracionales en la esfera pública. Eso se potencia con las redes sociales, que son una herramienta que facilita la expresión y también la distribución de esta locura y en las que también juega un rol fundamental el uso de algoritmos. El peligro que entraña esta unión de creencias falsas y redes sociales se pudo ver muy bien durante la campaña con la que ganó Bolsonaro en Brasil, donde WhatsApp fue fundamental.

![]()

11 jul 2019

Temas: Algoritmos, Ciencias Sociales, Computación, Ética, Filosofía, Inteligencia Artificial, Software